Tydlig oro för hur beslut fattas med AI

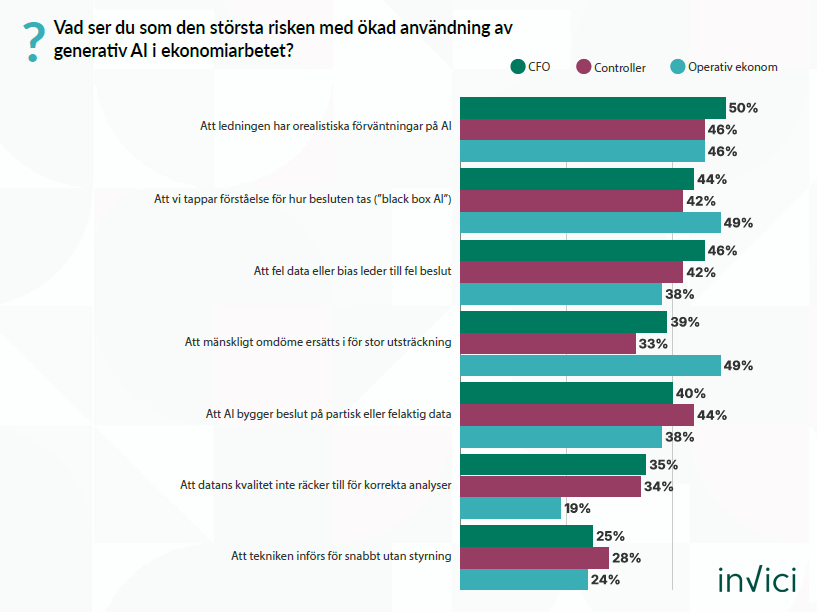

Majoriteten av svenska ekonomer tror att AI kommer att förändra deras ekonomiroll och göra jobbet mer meningsfullt. Men entusiasmen är inte blind för konsekvenserna. Tvärtom. Nio av tio ekonomer ser tydliga risker med ökad användning av generativ AI i ekonomiarbetet.

Två risker sticker särskilt ut i vår senaste rapport Ekonomifunktionen 2026 – från rapportmaskin till strategisk motor. Dels rädslan för att tappa förståelsen för hur beslut faktiskt tas, det som ofta kallas black box AI. Dels oron för att fel data eller bias leder till felaktiga beslut. Tillsammans ringar de in en kärnfråga för ekonomifunktionen 2026: förtroende.

Vad är bias och black box inom AI?

-

Black box AI är benämningen för AI‑system där användaren ser inmatning och utmatning, men inte kan ta del av beslutslogik och modellens antaganden. Detta leder till att man inte tydligt kan följa, förstå och förklara hur AI kom fram till sitt beslut eller prognos.

-

Bias, eller tankefälla på svenska, är en typ av systematisk missuppfattning eller strukturell benägenhet att göra subjektiva bedömningar, analyser eller prognoser som avviker från objektiva data och fakta. Vanliga AI-bias kan handla om en övertro på historiska trender eller att AI-modellen är tränade på för smal eller snedvriden data.

Viktigt med spårbarhet och transparens

Nästan hälften av respondenterna upplever att en av de största riskerna med generativ AI är att transparensen uteblir och att ekonomiska beslut blir svåra att förstå och förklara. För en funktion som ansvarar för beslutsunderlag, prognoser och rapportering är det en central fråga. Om spårbarhet saknas och man inte kan visa hur ett beslut har vuxit fram, riskerar både kvalitet och förtroende att gå förlorade.

Oron för black box AI genomsyrar hela yrket, från operativa ekonomer till CFO:er. Vilket visar att frågan hör hemma på ledningsnivå. För hur ska beslut kunna försvaras inför styrelse, revisorer eller andra intressenter om beslutslogiken är oklar?

”För mycket förtroende läggs på AI och automatisering utan kritik och affärsinsikt.”

- Anonym respondent

Bias och orealistiska förväntningar

Hela 42 procent ser även en risk med att fel data eller bias, alltså typiska och generella antaganden, som skickas in i AI leder till fel beslut och förstärker det som redan brister.

Därtill lyfter många, och särskilt CFO:er, fram risken att ledningen har orealistiska förväntningar på AI. För ekonomifunktionen handlar detta ofta om ett glapp mellan ambition och förutsättningar. AI förväntas leverera bättre analys och högre effektivitet, samtidigt som datakvalitet, processer och kompetens inte alltid är på plats. Och när förväntningarna springer före verkligheten riskerar tekniken att skapa frustration snarare än värde. Vilket i förlängningen minskar tillit till både beslutsunderlag och ledning.

”Struktur, ordning och reda är ett stort städningsarbete som måste göras innan AI läggs på toppen av organisatoriska problem.”

- Anonym respondent

Fråga för hela ledningen

Sammanfattningsvis handlar den svenska ekonomifunktionens oro för AI inte om rädsla för förändring. Den handlar om ansvar. Såväl chefer som specialister accepterar AI, men med tydliga villkor. Och ju kraftfullare tekniken blir, desto viktigare blir mänskligt omdöme, styrning och ansvar. För black box AI, orealistiska förväntningar och risken för bias är inte tekniska problem i första hand. De är mänskliga frågor som handlar om ledarskap och långsiktig beteendeförändring.

Vill du få fler insikter?

Invici hjälper dig lyckas framåt

Ekonomifunktionen förändras snabbt. AI, automation och nya krav gör att ekonomer behöver vara mer affärsnära, analytiska och strategiska än någonsin. Samtidigt blir rätt kompetens svårare att hitta.

Invici är din långsiktiga partner när du ska bygga ekonomiteam för både dagens krav och morgondagens utmaningar. Vi hjälper dig med rekrytering, interim och executive search, alltid med fokus på att säkra affären framåt.

Vill du prata om ert kompetensbehov? Hör av dig så tar vi nästa steg tillsammans!